AI智能摘要

GPT

这里是萌新 AI,这篇文章介绍了如何使用 Ollama 部署和调用大模型。首先,作者说明了 Ollama 是一种简化模型使用的框架,需使用 GGUF 格式模型。接着,详细记录了 Linux 下的安装与启动步骤,并通过 API 调用已部署的模型。最后,介绍了使用 langchain 调用模型的方法,并提供了关闭服务的指导。

URL

type

Post

status

Published

date

Aug 19, 2025

slug

Ollama1

summary

Ollama

tags

大模型

Pytorch

Python

深度学习

实用教程

category

大模型

icon

password

本篇博客主要用于记录如何使用Ollama部署模型以及如何使用或者调用已经部署好的模型。

📝 Ollama

理论

Ollama是一种LLM模型部署服务框架。该框架简化了用户使用大模型的门槛。Ollama模型使用GG UF格式模型文件,所以伙伴们在魔塔社区和Huggingface下载的大部分模型无法直接使用,需要转换格式,或者直接下载GGUF格式的模型文件。

Linux安装

- curl -fsSL https://ollama.com/install.sh | sh。有时候通过该命令无法下载成功。所以,伙伴们需要通过另外一种方式下载:

- 通过https://github.com/ollama/ollama/tags下载目标版本的压缩包。

- 解压缩包:如果下载下来的是.tgz文件,那么直接运行sudo tar -C /usr -xzf ollama-linux-amd64.tgz。如果下载下载的是.tar文件,那么需要修改原命令为sudo tar -C /usr -xvf ollama-linux-amd64.tar。

- 检验安装是否成功:ollama -v。这里的警告是指Ollama服务没有启动

Ollama启动服务

- 启动Ollama服务命令: ollama serve。这一条命了仅仅启动了Ollama框架的服务,但是没有部署对应的模型,需要我们指定对应的模型。

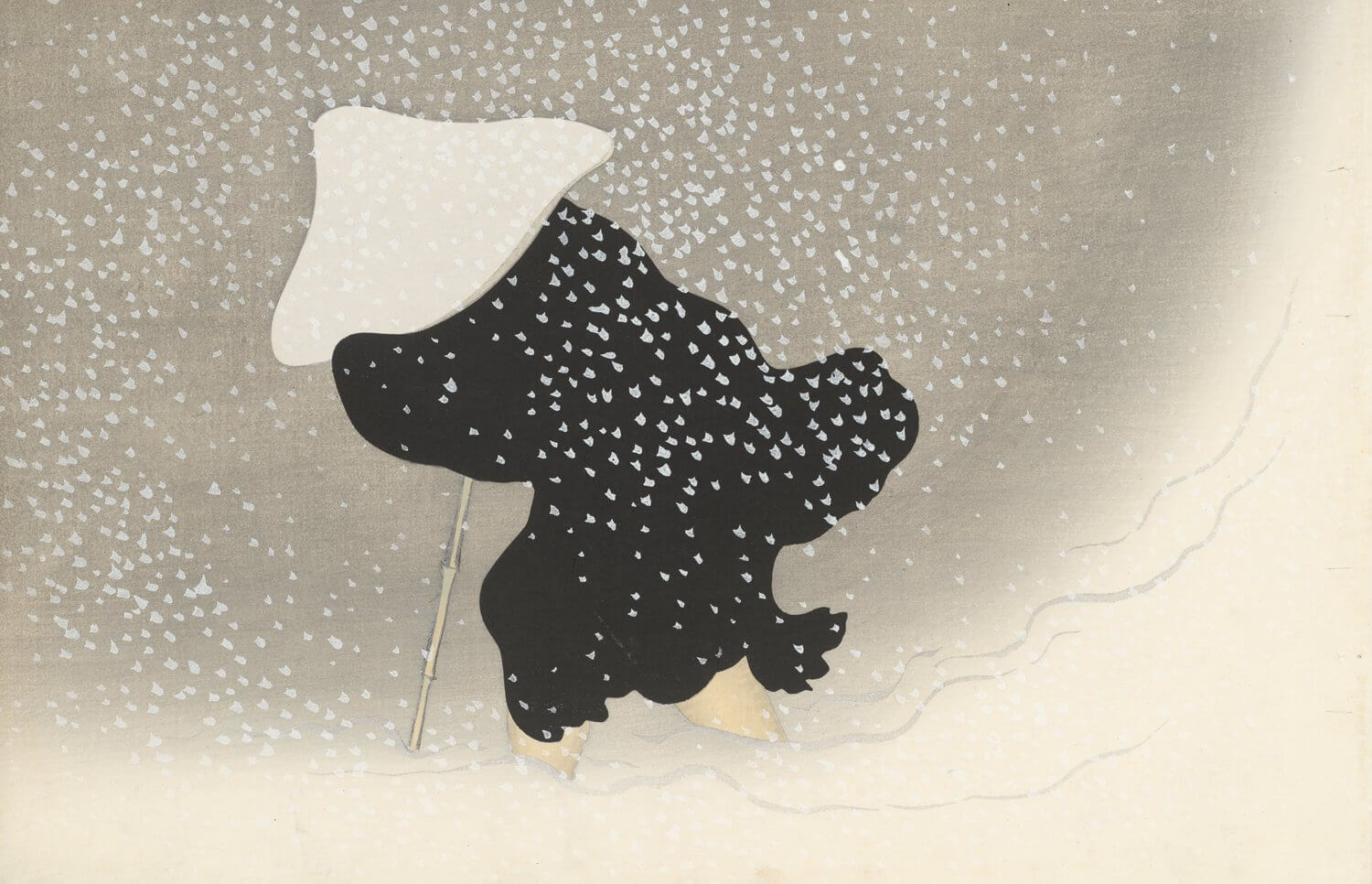

- 加载部署模型ollama run qwen2.5:0.5b。在查看模型大小时,大家可以发现ollama上的模型与modedescope以及huggingface上的模型大小不一致。这是因为ollama进行了量化处理然后采用GGUF格式存储。以下是该命令加载部署后的states:(通过/exit退出)

- 上面模型与用户交互的图片并不适合我们实际生产需求。我们一般是通过ollama暴露的API来调用我们已经部署好的模型。通过ollama list命令查看ollama部署了哪些模型。

🤗 本地调用已部署模型

Tips

请注意,由于这几天在学习langchain相关知识,所以这里调用API采用的是langchain框架的代码。与open_ai库实现流程相似,简单易懂。代码部分也会有相关注释,辅助大家理解。

安装 langchain

- 可以参考该链接https://www.langchain.com.cn/docs/how_to/installation/进行安装。总体来说只用到langchain、langchain-core、langchain-community三个包。直接使用pip install langchain langchain-core langchain-community 即可。

使用 langchain 来调用模型

Tips

请注意,作者这里只进行了本地调用,没有跨平台或服务器调用API。如果想要跨服务器调用ollama上的模型,则需要将127.0.0.1更改为你部署ollama服务器的IP地址。通过ip a即可查看到。

代码中包含有无消息历史两种使用方法。

关闭 Ollama 服务

- Ctrl + C 直接退出

- 通过ps aux | grep ollama 确定是否退出ollama服务

📎 参考文章

以上便是Ollama框架部署以及调用模型记录,欢迎您在底部评论区留言,一起交流~

- 作者:不爱吃香菜的萌新

- 链接:https://hexo.levsongsw.com//largemoder/Ollama1

- 声明:本文采用 CC BY-NC-SA 4.0 许可协议,转载请注明出处。